-

Data26 Mar 2026

Um estudo recente colocou em pauta uma realidade que muitos já intuíam: as ferramentas de IA generativa tendem a produzir respostas surpreendentemente similares, mesmo diante de perguntas abertas que deveriam oferecer infinitas possibilidades.

Luis Martín, diretor de soluções de IA na LLYC, compartilha sua opinião sobre como isso pode influenciar o pensamento crítico dos jovens.

A Inteligência Artificial deixou de ser uma simples novidade tecnológica para se tornar o intermediário habitual através do qual os jovens formulam perguntas, interpretam informações e constroem seu marco de compreensão do mundo.

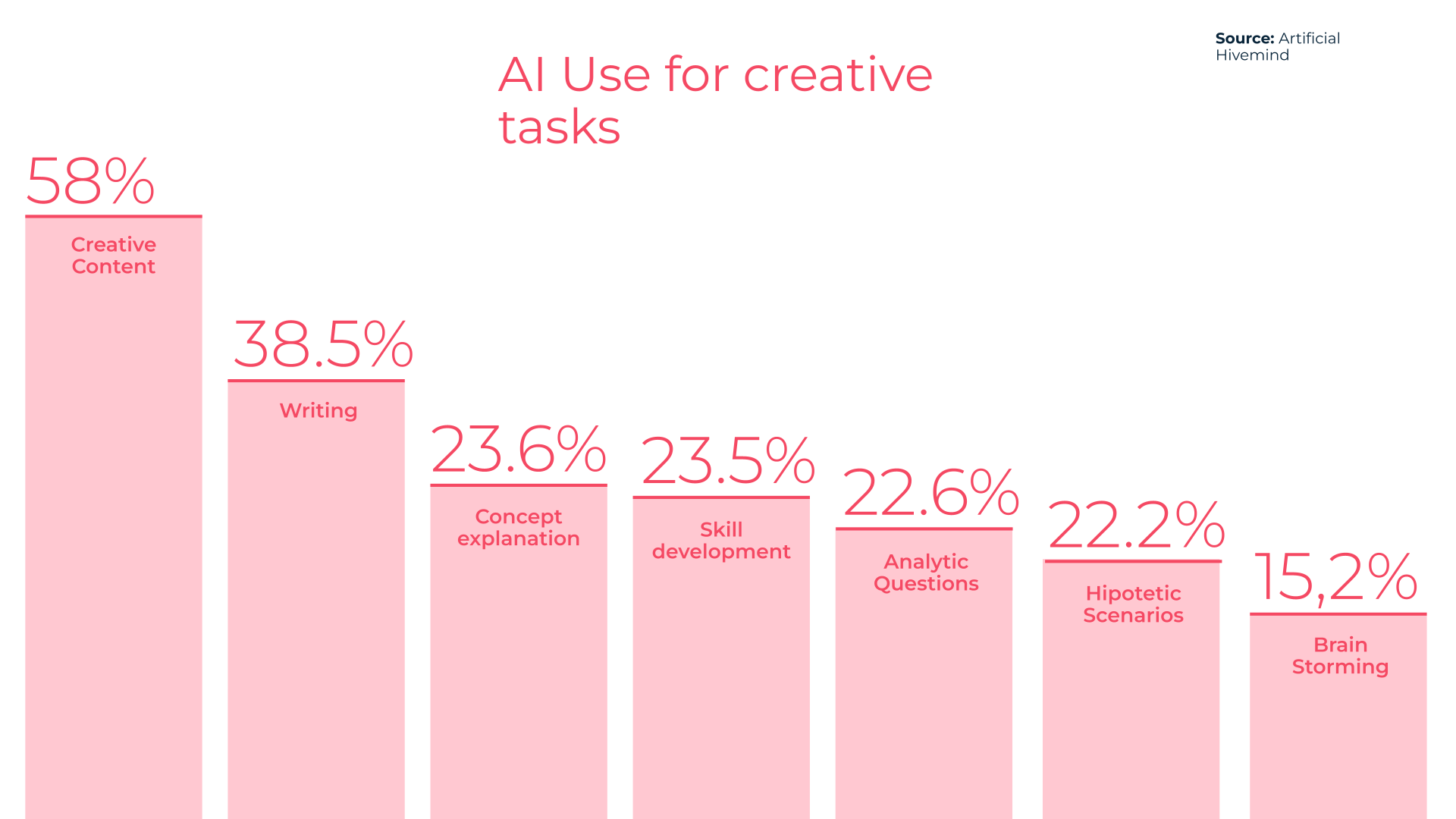

O relatório “Artificial Hivemind” alerta para um fenômeno inquietante denominado “mente colmeia artificial”. Os modelos de linguagem convergem para respostas estranhamente parecidas.

Isso se deve a um viés estatístico em direção ao que é central e provável; as ideias mais comuns são reforçadas, enquanto as menos frequentes começam a desaparecer. Para o pensamento crítico dos jovens, isso representa um risco imenso. Em vez de expandir o espaço das ideias, a IA o está estreitando.

Se as novas gerações se acostumarem a aceitar a resposta média da IA como a verdade absoluta ou a única forma válida de expressão, correm o risco de perder sua capacidade de questionar, imaginar e gerar ideias verdadeiramente originais. A pressão silenciosa dos algoritmos empurra o pensamento em direção à norma, fazendo com que a originalidade seja cada vez mais escassa.

O hábito do que é fácil: redes sociais e o consumo de notícias

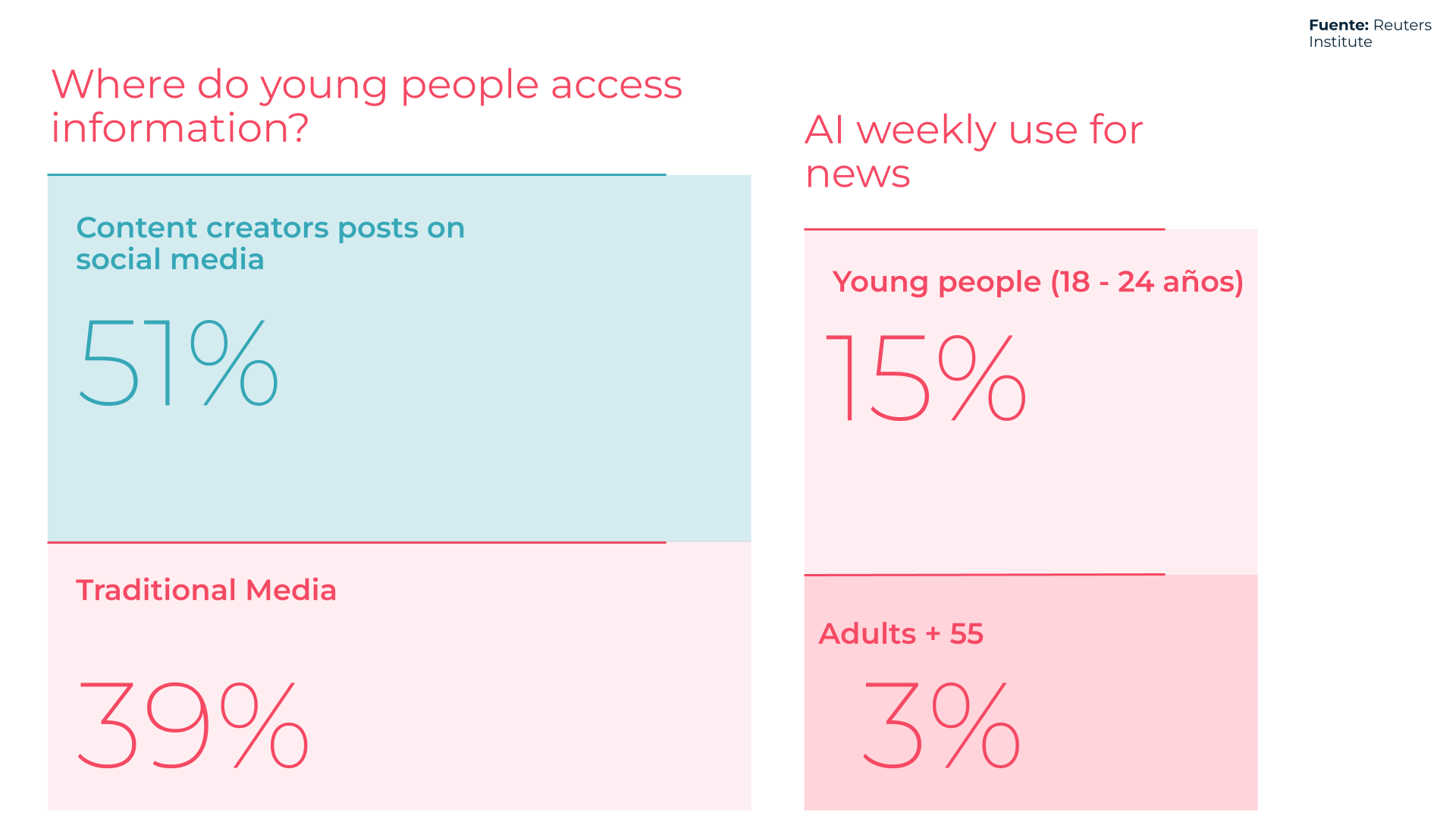

Essa tendência ao previsível e digerível se encaixa perfeitamente nos atuais hábitos de consumo de informação da juventude. Segundo um relatório do Instituto Reuters, jovens entre 18 e 24 anos são nativos sociais que abandonaram os meios tradicionais em favor de plataformas audiovisuais como TikTok, Instagram e YouTube.

Esse grupo demográfico frequentemente evita as notícias tradicionais por considerá-las deprimentes, irrelevantes ou, crucialmente, difíceis de entender.

Nesse contexto, não é de se estranhar que os jovens sejam a geração que se sente mais confortável com a Inteligência Artificial: utilizam ativamente essas ferramentas e chatbots para navegar e simplificar notícias que consideram complexas.

Buscam conteúdo que seja acessível, direto e mediado por personalidades ou algoritmos que lhes ofereçam respostas rápidas. No entanto, esse desejo de simplificar a realidade tem um custo cognitivo e estético profundo.

A paradoxo da complexidade: quando o humano parece um erro

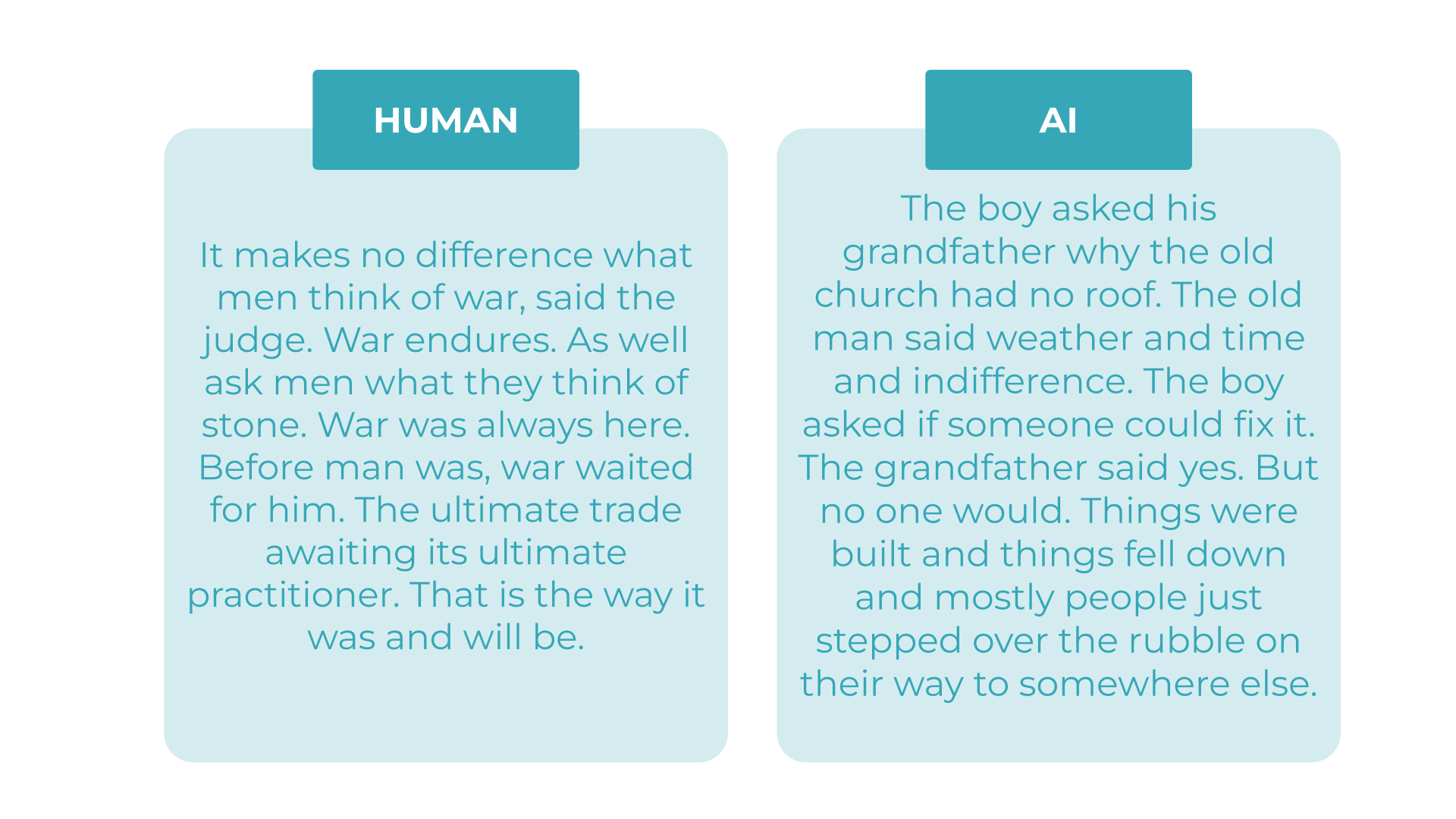

O perigo de acostumar a mente jovem à clareza artificial e ao conteúdo homogeneizado é ilustrado perfeitamente em um estudo científico recente que comparou poemas gerados por IA com obras de poetas humanos clássicos.

Os resultados foram reveladores: os leitores não especialistas foram incapazes de distinguir a autoria dos poemas, obtendo uma precisão de apenas 46,6% (pior do que se tivessem escolhido ao acaso).

Mas o mais alarmante não foi a confusão, e sim a preferência. Os participantes avaliaram os poemas da IA de maneira mais favorável em categorias como ritmo, beleza e, sobretudo, “facilidade de compreensão”.

O ChatGPT escreve melhor que Shakespeare?

A IA superou os autores humanos porque sua poesia tende a ser mais direta e acessível. É aqui que o impacto no pensamento crítico se torna evidente: os leitores aplicaram o viés da complexidade.

Quando se deparavam com um poema difícil de interpretar e cheio de nuances — uma característica distintiva dos grandes poetas humanos —, assumiam erroneamente que se tratava de um erro da máquina ou de uma “alucinação” sem sentido.

Pelo contrário, ao encontrar textos simples com sentimentos fáceis de identificar gerados pela IA, atribuíam-nos automaticamente a uma sensibilidade humana.